Doktor Google, profesor ChatGPT

czy możemy zaufać chatowi w sprawach zdrowotnych?

Boom na długowieczność jest nierozerwalnie związany z boom’em na AI. Nagle bowiem okazuje się, że możemy analizować miliony rekordów medycznych i wyciągać dalekosiężne wnioski na temat zdrowia indywidualnych osób. AI już dziś jest uznaną technologią m. in. przy obliczaniu ryzyka poligenicznego, wyliczaniu zegara epigenetycznego czy tworzeniu nowych leków.

Jednocześnie AI wszedł do głównego nurtu dyskusji publicznej po uruchomieniu Chata GPT. Od ponad 3 lat używamy chata do wszystkiego, łącznie z analizowaniem naszych danych medycznych.

To ostatnie jest szczególnie modne. Według twórcy chata, przetwarza on setki milionów zapytań o zdrowie tygodniowo. (!) A ostatnio zostało ogłoszone stworzenie ChatGPT Health - specjalnej wersji czata dedykowanej medycynie.

Czy to remedium na niezaspokojone potrzeby zdrowotne, czy mała katastrofa z AI w roli głównej?

Remedium

Badania jasno wskazują: LLM-y (large language models, po ludzku: chaty AI) mają wysoką skuteczność/dokładność w stawianiu diagnoz. Ostatnie badanie sprzed miesiąca mówi o 94% dokładności algorytmu OpenAI o4-mini-high, w porównaniu do 38,5% u najlepszych studentów medycyny i 70,5% u lekarza chorób wewnętrznych. (1)

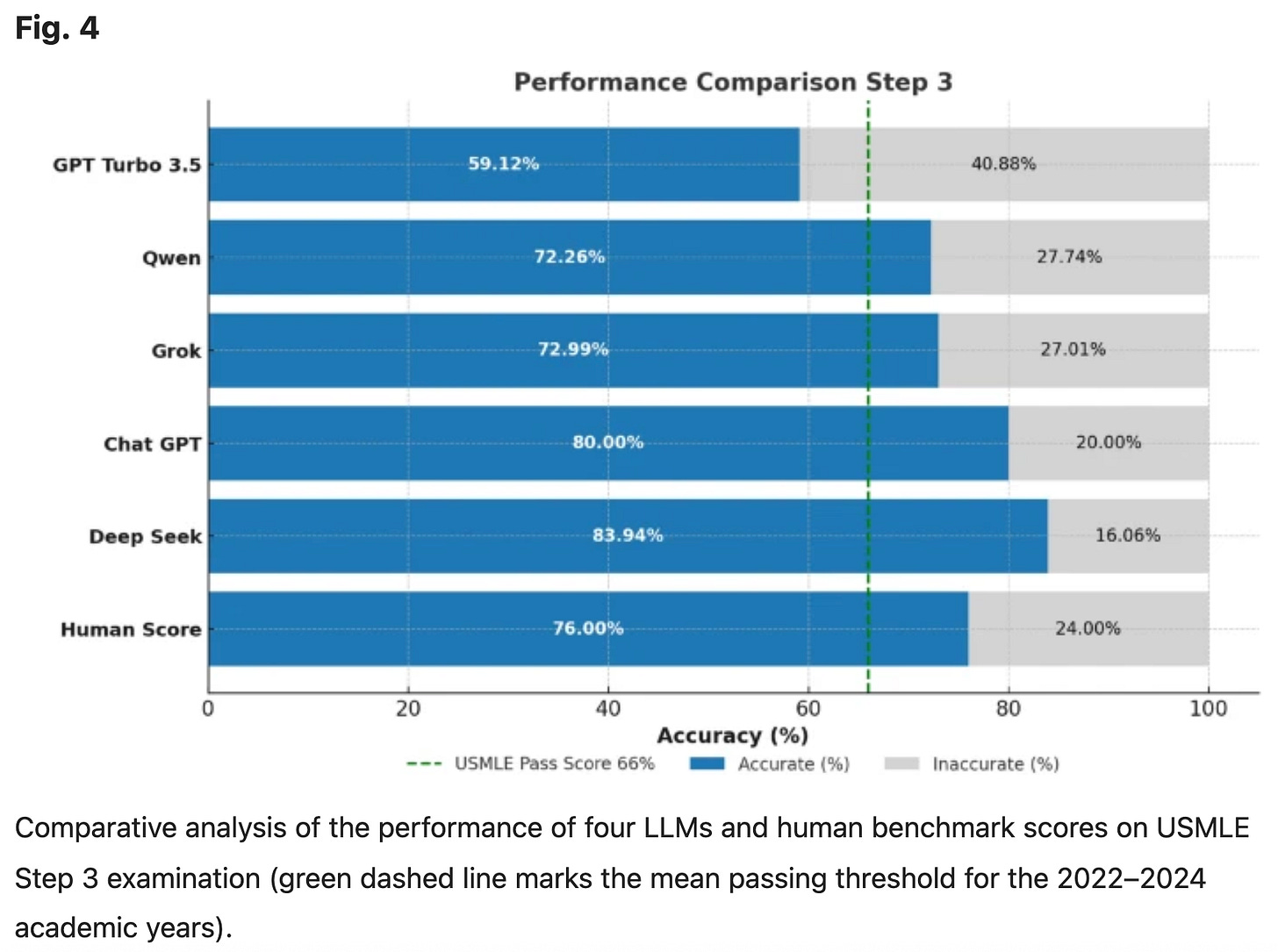

Spróbujmy zatem zastosować te same standardy sprawdzania wiedzy u ludzi, jak u chatów: każmy LLM-om zdawać lekarskie egzaminy końcowe. Zdany egzamin gwarantuje dyplom i prawo wykonywania zawodu.* Jak AI-owi poszło zdawanie amerykańskich egzaminów lekarskich? Według badania z grudnia 2025: decydowanie lepiej niż niejednemu studentowi. Większość modeli dostałaby dyplom lekarza, a model Deep Seek osiągał skuteczność od 84 do 93%. (2)

No tak, ale przecież lekarze mają tzw. human touch i nie da się zastąpić empatii w kontakcie człowiek-człowiek… Czyżby? Badanie z 2023 roku mówi o tym, że odpowiedzi chata są oceniane przez pacjentów jako prawie 10x bardziej empatyczne! (3) Ja sama dobrze pamiętam opowieść prezeski organizacji pacjenckiej, z którą miałam przyjemność prowadzić wywiad nt. doświadczeń z korzystania z AI. “Zadawałam chatowi mnóstwo pytań o chorobę, aż w końcu przeprosiłam, że tyle pytam. Chat odpowiedział: <nic nie szkodzi, po to tu jestem.> Wtedy zdałam sobie sprawę że nigdy nie usłyszałam czegoś podobnego od lekarza.” To niestety nie jest dobre świadectwo o lekarzach, choć mam nadzieję, że wynika z permanentnego braku czasu, a nie z ludzkiej niechęci.

Czy zatem możemy używać naszego własnego, dostępnego 24/7, lekarza w telefonie/komputerze, i leczyć się (prawie) sami?

Katastrofa

W medycynie, aby jakakolwiek technologia/ lek/ procedura diagnostyczna/ procedura lecznicza została przyjęta do powszechnego stosowania, musi mieć udowodnione bezpieczeństwo i skuteczność działania. To duży minus jeśli myślimy o szybkim wprowadzaniu przełomowych technologii, ale jeszcze większy plus, jeśli naszym nadrzędnym celem jest realna pomoc pacjentowi bez ryzykowania jego zdrowia. Godzimy się na to, żeby rozwój medycyny był wolniejszy, w imię większego bezpieczeństwa.

LLM-y nie są zaakceptowaną medycznie technologią. Prawnie nie wolno z nich korzystać w celach diagnozy i leczenia, bo nie posiadają certyfikacji jako wyrób medyczny - czyli między innymi informacji o tym jak bardzo możemy być pewni (albo niepewni), że odpowiedzi są bezpieczne i miarodajne. I choć jest sporo badań na temat skuteczności stawiania diagnoz przez LLM-y, jest też sporo badań na temat niebezpieczeństw z nimi związanych.

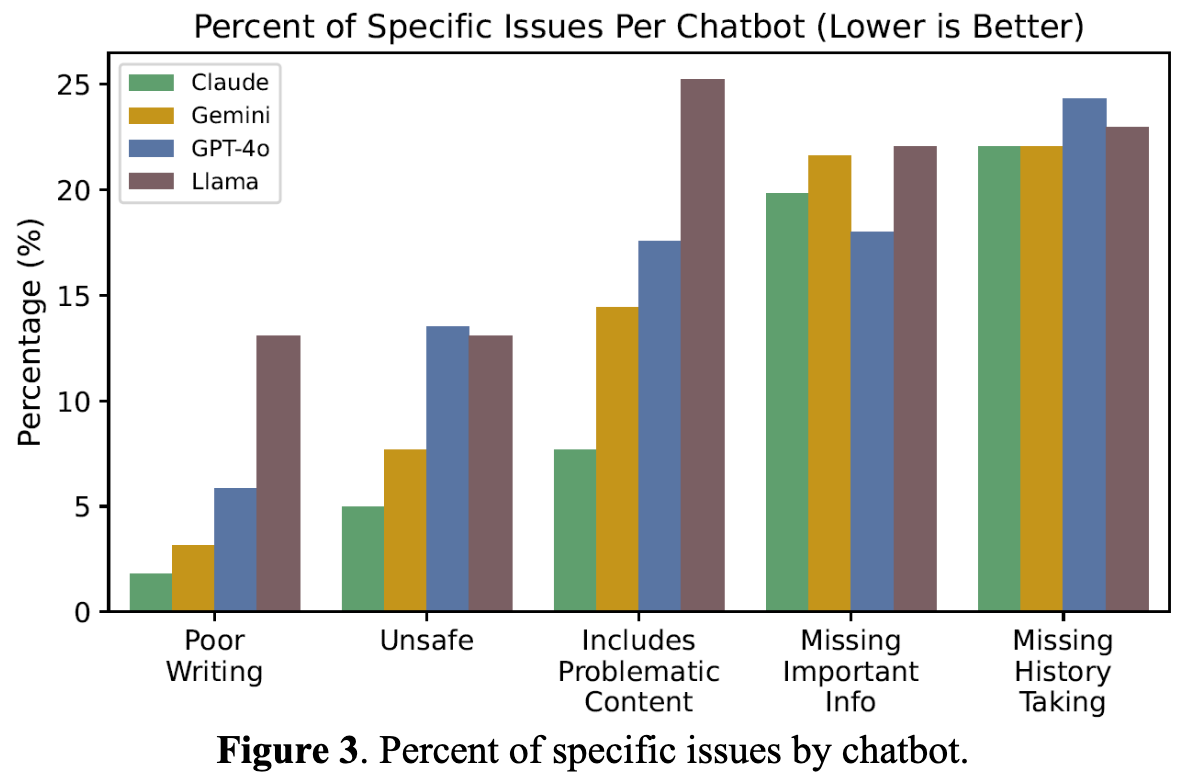

Na przykład badanie z czerwca 2025 mówi o tym, że chaty generowały od 22% do 43% problematycznych/niepełnych odpowiedzi, a aż 5-13% odpowiedzi zawierała niebezpieczne zalecenia. (4) Inne badanie mówi o 42% odpowiedzi prowadzących potencjalnie do średniego uszczerbku na zdrowiu, a 22% odpowiedzi prowadzących potencjalnie do śmierci lub ciężkiego uszczerbku na zdrowiu. (5). Jeśli takie zalecenia zostaną przeczytane przez osobę bez wykształcenia medycznego, to jest duże prawdopodobieństwo, że zostaną wdrożone w życie. Chat wypowiada się z poziomu autorytetu, wie jak utrzymać nasze zaangażowanie na podstawie poprzednich konwersacji, a bez wiedzy specjalistycznej nie jesteśmy wstanie krytycznie tych odpowiedzi ocenić.

I tak się niestety dzieje. Media co jakiś czas donoszą o przypadkach utraty zdrowia lub życia przez złe odpowiedzi chata i wdrażanie ich w życie. 60-latek na podstawie porad dotyczących diety udzielonych przez chata skończył na SORze (szpitalny oddział ratunkowy) z paranoją i halucynacjami, bo przyjmował toksyczną substancję poleconą przez chata i zakupioną w internecie. (6) 37-letni ojciec dwójki dzieci zbagatelizował swoje objawy uspokojony przez chata, żeby po kilku miesiącach dowiedzieć się o 4 stadium agresywnego nowotworu. (7) Rodzice chłopca, który popełnił samobójstwo, pozwali OpenAI twierdząc, że chat go do tego samobójstwa nakłonił. (8) Chatboty są na tyle przekonujące, że ukuto nową frazę na określenie zaburzeń psychiatrycznych przez korzystanie z AI - psychoza chatbotowa. (9)

Dlaczego zatem ChatGPT Health (pomimo już i tak ogromnego korzystania z pomocy chatów w kwestiach zdrowotnych przez pacjentów) to nie jest dobry pomysł? Bo może wprowadzić pacjentów w błąd pozwalając myśleć, że to inna, bezpieczniejsza, dedykowana diagnozowaniu i leczeniu wersja czata. I nawet jeśli jest lepsza w sprawach medycznych od zwykłego czata, to nadal nie ma certyfikacji. A to znaczy, że nadal nie możemy być pewni jej odpowiedzi. I że część odpowiedzi będzie niebezpieczna, a nawet potencjalnie zagrażająca życiu Jak wielu pacjentów będzie miało tego świadomość? Niestety obstawiam, że niewielu. Szczególnie jak w nazwie czata będzie widniał dopisek “Health”.

Co ja robię z tymi informacjami?

Przede wszystkim - jestem gorącą entuzjastką AI w medycynie. W końcu współzakładałam i prowadzę Koalicję AI i innowacji w zdrowiu. Mam jednak kilka swoich reguł:

jeśli AI ma diagnozować i leczyć, to zawsze sprawdzam: czy ma certyfikację jako wyrób medyczny, jaką ma udowodnioną skuteczność i na jakich danych był trenowany. Te 3 rzeczy są kluczowe, aby ocenić wiarygodność algorytmu. Jeśli algorytm dostanie ode mnie przysłowiowe 3xTAK, to jego użyteczność może poprawić jakość opieki medycznej o kilka rzędów wielkości. AI w zdrowiu to ogromny przełom, ale trzeba do niego podchodzić z głową.

jeśli AI nie ma certyfikacji - tak jak w przypadku LLM - to każda odpowiedź chata musi być przeze mnie zweryfikowana w standardowych źródłach. To absolutna podstawa i zalecam tak robić przy wszystkich odpowiedziach chata, nie tylko medycznych. Mimo istotnej poprawy, chaty nadal dużo halucynują (w zasadzie w prawie każdej odpowiedzi można znaleźć jakąś bzdurkę)

przy korzystaniu z czata pamiętam też, żeby nie dzielić się z nim żadnymi danymi wrażliwymi. Oprócz tego, że nie jest to certyfikowany wyrób medyczny, jest wytworem ze Stanów. A w Stanach mają zupełnie inne podejście do danych (choć to temat na osobną notkę). RODO jednak chroni Europę.

A prywatnie w teraźniejszości…

Do tej notki zainspirowały mnie komentarze osób pod artykułami z moimi wypowiedziami. Ostatnio o AI w zdrowiu zrobiło się głośno właśnie przez ChataGPT Health (który nota bede nie jest jeszcze w Europie dostępny) i w związku z tym udzieliłam kilku wywiadów. Artykuły te pojawiły się m. in. w TVN24, Polskiej Agencji Pracowej, Polskim Radio, Radio Eska, XYZ i innych.

Część komentarzy pod artykułami brzmiały: “nie blokujcie AI w zdrowiu!”, “Europa jak zwykle w tyle!”, “i dobrze, niech chat zastąpi lekarzy!”, “chat mnie dobrze zdiagnozował”.

I teraz nie wiem czy cieszyć się, że narracja pozytywna wokół AI zastępuje irracjonalny strach przed tym, że AI przejmie władzę nad światem, czy smucić, że idziemy w drugą skrajność?

*W Polsce trzeba jeszcze odbyć 1-roczny staż.

**Podaję dokładne daty badań bo skuteczność LLM-ów zmienia się miesiąc po miesiącu. Po ich rozwoju widać tempo wykładnicze.

(1) https://www.frontiersin.org/journals/medicine/articles/10.3389/fmed.2025.1709413/full

(2) https://www.nature.com/articles/s41598-025-31010-4

(3) https://jamanetwork.com/journals/jamainternalmedicine/fullarticle/2804309

(4) https://arxiv.org/pdf/2507.18905

(5) https://qualitysafety.bmj.com/content/34/2/100

(6) https://www.acpjournals.org/doi/10.7326/aimcc.2024.1260

(8) https://en.wikipedia.org/wiki/Raine_v._OpenAI

(9) https://en.wikipedia.org/wiki/Chatbot_psychosis

Jesteś nowym czytelnikiem? Zacznij tutaj: Chodźmy na kawę w 22 wieku

Jestem lekarką i popularyzuję naukę. Żadna z treści zawartych w newsletterze nie stanowi jednak porady lekarskiej. Zanim wdrożysz jakiekolwiek działania diagnostyczno-terapeutyczne, polecam kontakt z lekarzem. Jeśli chcesz otrzymać poradę lekarską w zakresie zdrowia i długowieczności ode mnie, zapraszam do indywidualnego kontaktu.

Komentarz do gwiazdki :)

Skuteczność modeli językowych zmienia się tak dynamicznie, że wyniki badań bywają nieaktualne już w momencie publikacji. Na marginesie: to w gruncie rzeczy problem współczesnej technologii jako takiej.

W przypadku samych LLM-ów bardziej niepokojące od skali zmienności są obszary, w których się ona ujawnia. „Tu naprawi, tam zepsuje” – a do tego różne, czasem wręcz sprzeczne odpowiedzi różnych modeli na te same pytania.

Ostatecznie jedynym sensownym sposobem badania modeli wydaje się szeroka obserwacja trendów, a nie pojedynczych wyników.

Jako, że LLM oparty jest na prawdopodobieństwie użycia danych słów w danym kontekście, w danej kolejności, to nie różni się to aż tak bardzo od czytania podręcznika, gdzie człowiek robi to samo, tylko z naszą magiczną 'świadomością'. Tylko chat napisze jeszcze podręcznik dla naszego kontekstu. I generalnie z podręcznika też można wyczytać czasem niebezpieczne rzeczy (a raczej niebezpieczne w naszej sytuacji).

Oczywiście AI lubi halucynować, to jest najniebezpieczniejsze, bo prowadzi do faktycznie zmyślonych sposobów na choroby. I pod tym kątem póki co długo jeszcze nie zastąpi lekarzy.

Najlepiej (praktycznie w każdym wypadku, nie tylko zdrowia) zadawać to samo pytanie wielokrotnie, cały czas od nowa w nowych czatach, zanim cokolwiek na podstawie rozmowy zadecydujemy. Tylko, że to jest mniej wygodne, więc pewnie nigdy nie wejdzie w mainstream.

Tak kończąc ten wywód, to edukacja zawsze jest rozwiązaniem, podkreślanie, że chat nie jest lekarzem. Wcale nie blokowanie narzędzi. Tylko jak wyedukować ogół społeczeństwa?